Grundlagen[]

Die zweifaktorielle Varianzanalyse untersucht die Effekte zweier unabhängiger Größen auf eine abhängige Variable. Dabei kann der kombinierte Einfluss beider Faktoren ebenso untersucht werden wie der isolierte Einfluss jedes Faktors sowie eine mögliche Interaktion zwischen diesen. Im Vergleich zur einfaktoriellen Varianzanalyse, bei der lediglich der isolierte Einfluss eines Faktors auf die abhängige Variable betrachtet wurde, steigt also die Komplexität des untersuchten Szenarios und damit auch die Anzahl der durchzuführenden Tests und Rechenoperationen. Viele Elemente der einfaktoriellen Varianzanalyse bleiben aber auch gleich, so dass im Folgenden nur die Zusätze und Erweiterungen im Detail dargestellt werden.

Haupt- und Interaktionseffekte[]

Bei der zwei- bzw. der mehrfaktoriellen Varianzanalyse ist im Gegensatz zur einfaktoriellen Varianzanalyse noch in Haupt- und Interaktionseffekt zu unterscheiden, also zwischen dem isolierten und dem kombinierten Einfluss der Faktoren auf die abhängige Variable. Der mehrfaktoriellen Varianzanalyse liegt ein linear-additives Modell zugrunde – der Gesamteffekt setzt sich additiv aus Haupt- und Interaktionseffekten zusammen.

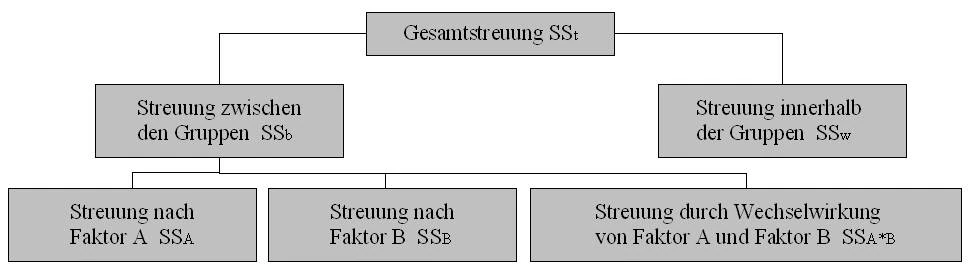

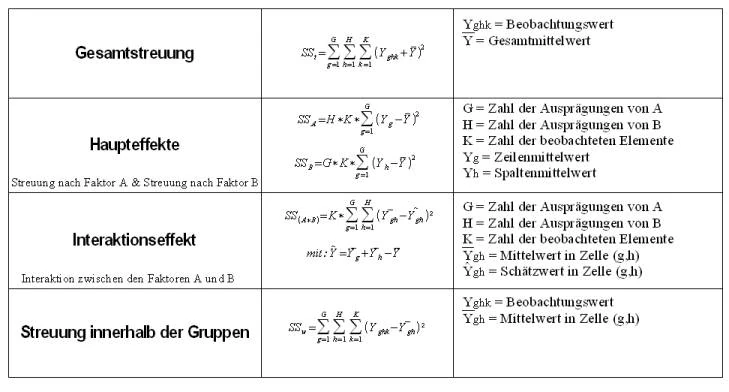

Die Streuungszerlegung gestaltet sich analog zur einfaktoriellen Varianzanalyse, nur dass neben der Streuung innerhalb des zweiten Faktors auch noch die Streuung hinzukommt, die der Wechselwirkung der beiden Faktoren zuzurechnen ist. Es ergeben sich also zwei statt nur einer neuen Streuungskomponente durch die Aufnahme eines weiteren Faktors in das Modell. Ähnlich stellt sich die Entwicklung bei der Aufnahme eines dritten Faktors dar: In diesem Fall gibt es dann schon acht Streuungskomponenten – die Komplexität der Varianzanalyse steigt also rapide mit der Anzahl der Faktoren.

Prüfung der statistischen Unabhängigkeit[]

Während im Rahmen der einfaktoriellen Varianzanalyse ein einzelner Test (varianzanalytischer F-Test) ausreicht, um das Gesamtmodell zu testen und anschließend über eine Reihe von Post-Hoc-Tests noch die einzelnen Faktorstufenmittelwerte auf Differenzen überprüft werden konnten, sind in der zweifaktoriellen Varianzanalyse drei separate Sets von Tests erforderlich, bevor mit den Post-Hoc-Tests begonnen werden kann.

Test des Gesamteffekts auf Signifikanz[]

Zunächst einmal wird, analog zur einfaktoriellen Varianzanalyse, die Nullhypothese getestet, dass alle Faktorstufenmittelwerte (aller Faktoren!) identisch sind und es demzufolge keine signifikanten, durch die Faktoren bestimmten Mittelwertunterschiede zwischen den einzelnen Gruppen gibt. Auch hier kann die Prüfgröße der F-Verteilung entnommen werden.

Test der Haupteffekte A und B[]

Wurde beim vorangegangenen Test ein signifikanter Gesamteffekt festgestellt, so ist noch nicht klar, ob dieser durch einen oder beide Faktoren des zweifaktoriellen Modells ausgelöst wurde. Der Test des Gesamteffekts wird ja bereits signifikant, wenn es nur einen Mittelwertunterschied zwischen zwei Faktorstufen der Grundgesamtheit gibt, die ja durchaus zum gleichen Faktor gehören können. Daher ist ein separater Test beider Haupteffekte notwendig, wobei bereits feststeht, dass mindestens einer der beiden signifikant werden muss. Die Nullhypothese dieses Tests lautet wieder: Alle Faktorstufenmittelwerte (diesmal innerhalb A oder B) sind identisch. Die Prüfgröße kann ebenfalls wieder der F-Verteilung entnommen werden.

Test auf Interaktionseffekte[]

Anschließend ist noch auf Interaktionseffekte zu testen – inwiefern existiert also eine Interaktion zwischen den beiden Faktoren. Die H0 dieses Tests lautet konsequenterweise: Die Mittelwerte sämtlicher Interaktionsstufen sind identisch, daher liegt keine Interaktion zwischen den Faktoren vor.

Kann diese Nullhypothese verworfen werden, ist von dem Vorhandensein signifikanter Interaktionseffekte auszugehen, die in einem zusätzlichen fünften Schritt der mehrfaktoriellen Varianzanalyse nun noch interpretiert werden müssen.

Interpretation der Interaktionseffekte[]

Liegen signifikante Interaktion zwischen den Faktoren vor, wird die Interpretation der Haupteffekte erheblich erschwert, unter Umständen bis zu einem Punkt, an dem keiner der Haupteffekte überhaupt noch isoliert interpretiert werden kann. Der Einfluss eines interagierenden Faktors kann im Grunde nur adäquat dargestellt werden, wenn gleichzeitig stets auchere Faktor betrachtet wird.

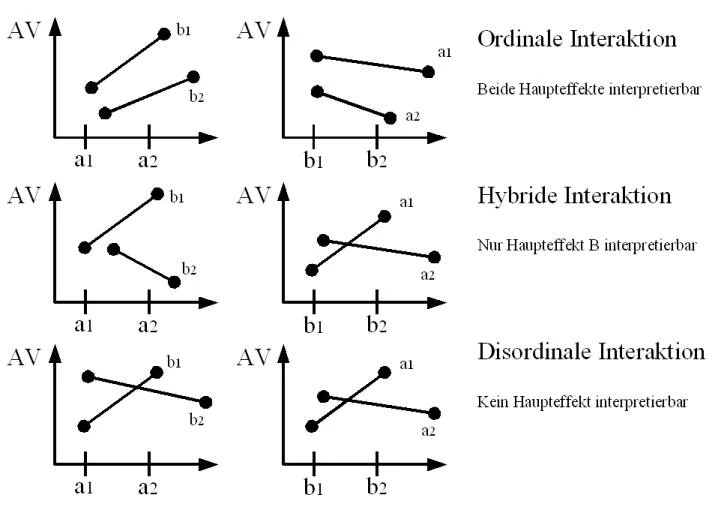

Interaktionsdiagramme helfen bei der komplexen Interpretation der Interaktionseffekte, indem sie diese grafisch veranschaulichen. In ihnen werden sämtliche Gruppenmittelwerte, getrennt nach Faktoren, gegeneinander abgetragen. Es ergeben sich zwei Verlaufsformen:

Parallele Verläufe = Es liegt keine Interaktion zwischen den Faktoren vor. In diesem Fall sind die Haupteffekte problemlos isoliert interpretierbar und ergeben in ihrer Summe den Gesamteffekt. Das Nichtvorhandensein von Interaktionseffekten sollte sich aber auch schon im Test auf Interaktionseffekte zeigen – die Erstellung von Interaktionsdiagrammen ist im Falle eines nicht-signifikanten Tests im Grund überflüssig.

Nichtparallele Verläufe = Es liegen Interaktionen zwischen den Faktoren vor. In diesem Fall können die Haupteffekte eventuell nicht mehr inhaltlich interpretiert werden. Die Art der Interaktion ergibt sich aus der Art des Verlaufs, wobei in drei mögliche Verlaufsformen zu unterscheiden ist:

- Ordinale Interaktion = Die Linienzüge weisen in beiden Diagrammen den gleichen Trend auf und schneiden sich daher nicht. In solchen Fällen sind beide Haupteffekte auch isoliert noch sinnvoll interpretierbar.

- Hybride Interaktion = Die Linienzüge schneiden sich nur in einem der beiden Diagramme. In diesem Fall ist nur der Haupteffekt inhaltlich interpretierbar, dessen Linienzüge sich nicht kreuzen.

- Disordinale Interaktion = Die Linienzüge schneiden sich in beiden Diagrammen. In diesem Fall kann keiner der Haupteffekte mehr inhaltlich interpretiert werden.

Quellen[]

C. Reinboth: Multivariate Analyseverfahren in der Marktforschung, LuLu-Verlagsgruppe, Morrisville, 2006.

Fahrmeir, L., Künstler, R., Pigeot, I. & Tutz, G. (1999). Statistik. Der Weg zur Datenanalyse (2. Aufl.). Berlin: Springer.

Brosius, F. (2002). SPSS 11. Bonn: mitp-Verlag.

Götze, W., Deutschmann, C. & Link, H. (2002). Statistik. München: Oldenbourg.

Hair, J.F., Anderson, R.E., Tatham, R.L. & Black, W.C. (1998). Multivariate data analysis (5th ed.). Upper Saddle River, NJ: Prentice Hall.

Janssen, J. & Laatz, W. (2003). Statistische Analyse mit SPSS für Windows (4. Aufl.). Berlin: Springer.